Noong 1956, sa loob ng isang taon na paglalakbay sa London at sa kanyang unang bahagi ng 20s, binisita ng mathematician at theoretical biologist na si Jack D. Cowan si Wilfred Taylor at ang kanyang kakaibang bagong “makina ng pag-aaral”. Sa kanyang pagdating ay nataranta siya sa "malaking bangko ng kagamitan" na humarap sa kanya. Nakatayo lang si Cowan at panoorin ang "ginagawa ang makina". Ang bagay na tila ginagawa nito ay gumaganap ng isang "associative memory scheme" - tila natututo ito kung paano maghanap ng mga koneksyon at kumuha ng data.

Maaaring ito ay mukhang clunky blocks ng circuitry, na pinagsama-sama sa pamamagitan ng kamay sa isang masa ng mga wire at mga kahon, ngunit ang nasaksihan ni Cowan ay isang maagang analogue form ng isang neural network - isang pasimula sa pinaka advanced na artificial intelligence sa ngayon, kabilang ang maraming napag-usapan Chat GPT na may kakayahang bumuo ng nakasulat na nilalaman bilang tugon sa halos anumang utos. Ang pinagbabatayan na teknolohiya ng ChatGPT ay isang neural network.

Habang nakatayo sina Cowan at Taylor at pinagmamasdan ang paggana ng makina, talagang wala silang ideya kung paano ito namamahala upang maisagawa ang gawaing ito. Ang sagot sa misteryosong utak ng makina ni Taylor ay matatagpuan sa isang lugar sa "analog neurons" nito, sa mga asosasyong ginawa ng memorya ng makina nito at, higit sa lahat, sa katotohanan na ang automated na paggana nito ay hindi talaga maipaliwanag nang lubusan. Aabutin ng mga dekada para mahanap ng mga system na ito ang kanilang layunin at ma-unlock ang kapangyarihang iyon.

Ang terminong neural network ay nagsasama ng isang malawak na hanay ng mga sistema, ngunit sa gitna, ayon sa IBM, ang mga "neural network na ito - na kilala rin bilang mga artificial neural network (ANNs) o simulated neural networks (SNNs) - ay isang subset ng machine learning at nasa gitna ng malalim na pag-aaral ng mga algorithm." Mahalaga, ang termino mismo at ang kanilang anyo at "istruktura ay inspirasyon ng utak ng tao, na ginagaya ang paraan ng pagbibigay ng signal ng mga biological neuron sa isa't isa".

Maaaring may ilang natitirang pag-aalinlangan sa kanilang halaga sa mga unang yugto nito, ngunit sa paglipas ng mga taon, ang AI fashions ay matatag na lumipat patungo sa mga neural network. Sila ngayon ay madalas na nauunawaan na ang hinaharap ng AI. Malaki ang implikasyon nila sa atin at sa kung ano ang ibig sabihin ng pagiging tao. Narinig namin echo ng mga alalahaning ito kamakailan na may mga tawag na i-pause ang mga bagong pagpapaunlad ng AI sa loob ng anim na buwang panahon upang matiyak ang tiwala sa kanilang mga implikasyon.

Tiyak na isang pagkakamali na bale-walain ang neural network bilang tungkol lamang sa makintab, kapansin-pansing mga bagong gadget. Sila ay matatag na sa ating buhay. Ang ilan ay makapangyarihan sa kanilang pagiging praktikal. Noong 1989, ang isang pangkat na pinamumunuan ni Yann LeCun sa AT&T Bell Laboratories ay gumamit ng mga diskarte sa back-propagation upang sanayin ang isang sistema upang kilalanin ang mga sulat-kamay na postal code. ang mga kamakailan-lamang anunsyo ng Microsoft na ang mga paghahanap sa Bing ay papaganahin ng AI, na ginagawa itong iyong "kopilot para sa web", ay naglalarawan kung paano ang mga bagay na aming natuklasan at kung paano namin naiintindihan ang mga ito ay lalong magiging produkto ng ganitong uri ng automation.

Ang pagguhit sa malawak na data upang makahanap ng mga pattern ay maaaring sanayin ang AI na gawin ang mga bagay tulad ng pagkilala sa imahe nang mabilis - na nagreresulta sa mga ito na isinama sa facial recognition, halimbawa. Ang kakayahang ito na makilala ang mga pattern ay humantong sa maraming iba pang mga application, tulad ng paghula sa mga pamilihan ng sapi.

Binabago ng mga neural network kung paano namin binibigyang-kahulugan at nakikipag-usap din. Binuo ng kawili-wiling pinamagatang Google Brain Team, Google translate ay isa pang kilalang aplikasyon ng isang neural network.

Hindi mo nais na maglaro ng Chess o Shogi sa isa. Ang kanilang pagkaunawa sa mga panuntunan at ang kanilang pag-alala sa mga estratehiya at lahat ng naitalang galaw ay nangangahulugan na sila ay napakahusay sa mga laro (bagaman ang ChatGPT ay tila pakikibaka kay Wordle). Ang mga system na bumabagabag sa mga manlalaro ng Go (Go ay isang kilalang-kilala na nakakalito na diskarte sa board game) at mga grandmaster ng Chess, ay ginawa mula sa mga neural network.

Ngunit ang kanilang naaabot ay higit pa sa mga pagkakataong ito at patuloy na lumalawak. Ang paghahanap ng mga patent na pinaghihigpitan lamang sa pagbanggit ng eksaktong pariralang "mga neural network" ay gumagawa ng 135,828 resulta. Sa mabilis at patuloy na pagpapalawak na ito, ang pagkakataong ganap nating maipaliwanag ang impluwensya ng AI ay maaaring maging mas payat. Ito ang mga tanong na aking sinusuri sa aking pananaliksik at ang aking bagong libro sa algorithmic na pag-iisip.

Mga mahiwagang layer ng 'unknowability'

Ang pagbabalik-tanaw sa kasaysayan ng mga neural network ay nagsasabi sa amin ng isang bagay na mahalaga tungkol sa mga automated na desisyon na tumutukoy sa ating kasalukuyan o sa mga posibleng magkaroon ng mas malalim na epekto sa hinaharap. Sinasabi rin sa amin ng kanilang presensya na malamang na mas mauunawaan namin ang mga desisyon at epekto ng AI sa paglipas ng panahon. Ang mga sistemang ito ay hindi lamang mga itim na kahon, ang mga ito ay hindi lamang mga nakatagong piraso ng isang sistema na hindi nakikita o naiintindihan.

Ito ay isang bagay na naiiba, isang bagay na nakaugat sa mga layunin at disenyo ng mga sistemang ito mismo. Mayroong matagal na pagtugis ng hindi maipaliwanag. Kung mas malabo, mas authentic at advanced ang system na iniisip. Ito ay hindi lamang tungkol sa mga sistema na nagiging mas kumplikado o ang kontrol ng intelektwal na pag-aari na naglilimita sa pag-access (bagaman ang mga ito ay bahagi nito). Sa halip, sabihin na ang etos na nagtutulak sa kanila ay may partikular at naka-embed na interes sa "hindi nalalaman". Ang misteryo ay kahit na naka-code sa mismong anyo at diskurso ng neural network. Ang mga ito ay may kasamang malalim na nakasalansan na mga layer - kaya ang pariralang malalim na pag-aaral - at sa kalaliman na iyon ay ang mas mahiwagang tunog na "nakatagong mga layer". Ang mga misteryo ng mga sistemang ito ay malalim sa ilalim ng ibabaw.

Malaki ang posibilidad na kung mas malaki ang epekto ng artificial intelligence sa ating buhay ay hindi natin mauunawaan kung paano o bakit. Ngayon ay may malakas na pagtulak para sa AI na maipaliwanag. Gusto naming malaman kung paano ito gumagana at kung paano ito nauuwi sa mga desisyon at kinalabasan. Ang EU ay labis na nag-aalala sa mga potensyal na "hindi katanggap-tanggap na mga panganib" at kahit na "mapanganib" na mga aplikasyon na kasalukuyan itong sumusulong isang bagong AI Act nilayon na magtakda ng "pandaigdigang pamantayan" para sa "pagbuo ng ligtas, mapagkakatiwalaan at etikal na artificial intelligence".

Ang mga bagong batas na iyon ay ibabatay sa pangangailangan para sa pagpapaliwanag, hinihingi iyon "para sa mga high-risk AI system, ang mga kinakailangan ng mataas na kalidad na data, dokumentasyon at traceability, transparency, pangangasiwa ng tao, katumpakan at katatagan, ay mahigpit na kinakailangan upang mapagaan ang mga panganib sa mga pangunahing karapatan at kaligtasan na dulot ng AI." Ito ay hindi lamang tungkol sa mga bagay tulad ng mga self-driving na kotse (bagama't ang mga system na nagtitiyak ng kaligtasan ay nabibilang sa kategorya ng high risk AI ng EU), ito rin ay isang pag-aalala na ang mga system ay lalabas sa hinaharap na magkakaroon ng mga implikasyon para sa mga karapatang pantao.

Bahagi ito ng mas malawak na panawagan para sa transparency sa AI para masuri, ma-audit at masuri ang mga aktibidad nito. Ang isa pang halimbawa ay ang Royal Society's policy briefing sa maipaliwanag na AI kung saan itinuturo nila na "ang mga debate sa patakaran sa buong mundo ay lalong nakakakita ng mga panawagan para sa ilang anyo ng AI-explainability, bilang bahagi ng mga pagsisikap na i-embed ang mga etikal na prinsipyo sa disenyo at pag-deploy ng mga AI-enabled system."

Ngunit ang kuwento ng mga neural network ay nagsasabi sa atin na malamang na mas malayo tayo sa layuning iyon sa hinaharap, sa halip na mas malapit dito.

May inspirasyon ng utak ng tao

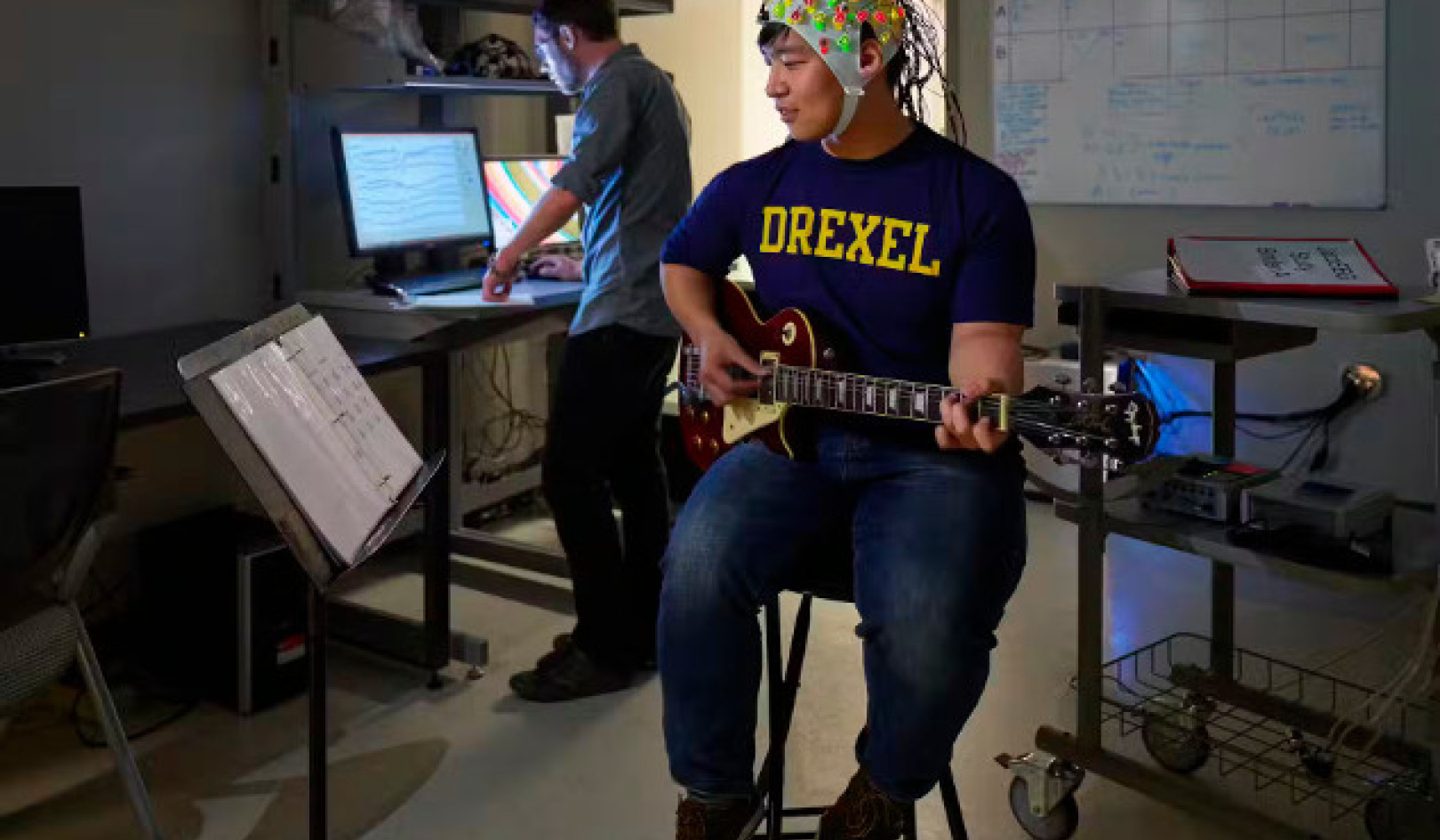

Ang mga neural network na ito ay maaaring kumplikadong mga sistema ngunit mayroon silang ilang mga pangunahing prinsipyo. Dahil sa inspirasyon ng utak ng tao, hinahangad nilang kopyahin o gayahin ang mga anyo ng biyolohikal at pag-iisip ng tao. Sa mga tuntunin ng istraktura at disenyo sila ay, bilang Ipinaliwanag din ng IBM, na binubuo ng "mga node layer, na naglalaman ng input layer, isa o higit pang nakatagong layer, at isang output layer." Sa loob nito, "ang bawat node, o artipisyal na neuron, ay nag-uugnay sa isa pa". Dahil nangangailangan sila ng mga input at impormasyon upang lumikha ng mga output, sila ay "umaasa sa data ng pagsasanay upang matutunan at mapabuti ang kanilang katumpakan sa paglipas ng panahon". Ang mga teknikal na detalyeng ito ay mahalaga ngunit gayon din ang pagnanais na imodelo ang mga sistemang ito sa mga kumplikado ng utak ng tao.

Ang pag-unawa sa ambisyon sa likod ng mga sistemang ito ay mahalaga sa pag-unawa kung ano ang ibig sabihin ng mga teknikal na detalyeng ito sa pagsasanay. Sa isang 1993 pakikipanayam, ang neural network scientist na si Teuvo Kohonen ay naghinuha na ang isang "self-organizing" system "ay ang aking pangarap", na nagpapatakbo ng "isang bagay na tulad ng kung ano ang ginagawa ng ating nervous system nang katutubo". Bilang halimbawa, inilarawan ni Kohonen kung paano ang isang "self-organizing" system, isang sistema na sumusubaybay at namamahala sa sarili nito, "ay maaaring gamitin bilang isang monitoring panel para sa anumang makina ... sa bawat eroplano, jet plane, o bawat nuclear power station, o bawat kotse”. Ito, naisip niya, ay nangangahulugan na sa hinaharap "makikita mo kaagad kung ano ang kalagayan ng sistema".

Ang pangkalahatang layunin ay magkaroon ng isang sistema na may kakayahang umangkop sa kapaligiran nito. Ito ay magiging instant at autonomous, na tumatakbo sa istilo ng nervous system. Iyon ang pangarap, na magkaroon ng mga sistema na kayang hawakan ang kanilang mga sarili nang hindi nangangailangan ng maraming interbensyon ng tao. Ang mga kumplikado at hindi alam ng utak, sistema ng nerbiyos at ang totoong mundo ay malapit nang dumating upang ipaalam ang pagbuo at disenyo ng mga neural network.

'May kakaiba tungkol dito'

Ngunit sa pagbabalik sa 1956 at ang kakaibang learning machine na iyon, ang hands-on na diskarte na ginawa ni Taylor nang itayo ito ang agad na nakakuha ng atensyon ni Cowan. Siya ay malinaw na pinagpawisan sa pagtitipon ng mga piraso at piraso. Taylor, Tinignan ni Cowan sa isang panayam sa kanyang sariling bahagi sa kuwento ng mga sistemang ito, "hindi niya ito ginawa ayon sa teorya, at hindi niya ito ginawa sa isang computer". Sa halip, na may mga tool sa kamay, siya ay "talagang nagtayo ng hardware". Ito ay isang materyal na bagay, isang kumbinasyon ng mga bahagi, marahil kahit isang kasangkapan. At ito ay "lahat tapos na sa analogue circuitry" pagkuha Taylor, Cowan tala, "ilang taon upang itayo ito at upang paglaruan ito". Isang kaso ng trial and error.

Understandably gusto ni Cowan na mahawakan ang kanyang nakikita. Sinubukan niyang ipapaliwanag ni Taylor sa kanya ang learning machine na ito. Ang mga paglilinaw ay hindi dumating. Hindi makuha ni Cowan si Taylor na ilarawan sa kanya kung paano gumagana ang bagay. Ang mga analogue neuron ay nanatiling isang misteryo. Ang mas nakakagulat na problema, naisip ni Cowan, ay si Taylor ay "hindi talaga naiintindihan ang kanyang sarili kung ano ang nangyayari". Ito ay hindi lamang isang panandaliang pagkasira ng komunikasyon sa pagitan ng dalawang siyentipiko na may magkaibang mga espesyalismo, ito ay higit pa doon.

Sa isang panayam mula sa kalagitnaan ng 1990s, sa pag-iisip pabalik sa makina ni Taylor, ipinahayag ni Cowan na "hanggang ngayon sa mga nai-publish na papel ay hindi mo lubos na maunawaan kung paano ito gumagana". Ang konklusyon na ito ay nagpapahiwatig kung paano malalim na naka-embed ang hindi alam sa mga neural network. Ang hindi maipaliwanag na mga sistema ng neural na ito ay naroroon kahit na mula sa mga pundamental at yugto ng pag-unlad na itinayo noong halos pitong dekada.

Ang misteryong ito ay nananatili ngayon at makikita sa loob ng mga sumusulong na anyo ng AI. Ang hindi maarok ng paggana ng mga asosasyong ginawa ng makina ni Taylor ay humantong kay Cowan na magtaka kung mayroong "isang bagay na hindi kapani-paniwala tungkol dito".

Mahahaba at gusot ang mga ugat

Tinukoy ni Cowan ang kanyang maikling pagbisita kay Taylor nang tanungin tungkol sa pagtanggap ng kanyang sariling gawain makalipas ang ilang taon. Noong 1960s, ang mga tao ay, sumasalamin si Cowan, "medyo mabagal upang makita ang punto ng isang analogue neural network". Ito ay sa kabila, naalala ni Cowan, ang 1950s ni Taylor ay nagtatrabaho sa "associative memory" na batay sa "analog neurons". Ang dalubhasa sa neural system na nanalo ng Nobel Prize, Leon N. Cooper, nagtapos na ang mga pag-unlad sa paligid ng paggamit ng modelo ng utak noong 1960s, ay itinuturing na "bilang sa malalim na misteryo". Dahil sa kawalan ng katiyakan na ito ay nanatili ang isang pag-aalinlangan tungkol sa kung ano ang maaaring makamit ng isang neural network. Ngunit ang mga bagay ay unti-unting nagbago.

Mga 30 taon na ang nakalilipas ang neuroscientist na si Walter J. Freeman, na nagulat sa "kapansin-pansin” hanay ng mga application na natagpuan para sa mga neural network, ay nagkomento na sa katotohanang hindi niya nakita ang mga ito bilang “isang panimula na bagong uri ng makina”. Ang mga ito ay isang mabagal na paso, na ang teknolohiya ay nauuna at pagkatapos ay ang mga kasunod na aplikasyon ay natagpuan para dito. Nagtagal ito. Sa katunayan, upang mahanap ang mga ugat ng teknolohiya ng neural network maaari tayong bumalik nang higit pa kaysa sa pagbisita ni Cowan sa mahiwagang makina ni Taylor.

Ang neural net scientist na si James Anderson at ang science journalist na si Edward Rosenfeld na nabanggit na ang background sa mga neural network ay bumalik noong 1940s at ilang maagang pagtatangka na, gaya ng inilalarawan nila, "maunawaan ang mga sistema ng nerbiyos ng tao at bumuo ng mga artipisyal na sistema na kumikilos sa paraang ginagawa natin, kahit kaunti lang". At kaya, noong 1940s, ang mga misteryo ng sistema ng nerbiyos ng tao ay naging mga misteryo din ng computational thinking at artificial intelligence.

Ang pagbubuod sa mahabang kuwentong ito, ang manunulat ng computer science Itinuro ni Larry Hardesty na ang malalim na pag-aaral sa anyo ng mga neural network ay "lumabas at lumalabas sa uso sa loob ng higit sa 70 taon". Higit na partikular, idinagdag niya, ang mga "neural network na ito ay unang iminungkahi noong 1944 ni Warren McCulloch at Walter Pitts, dalawang mananaliksik sa Unibersidad ng Chicago na lumipat sa MIT noong 1952 bilang mga founding member ng kung minsan ay tinatawag na unang cognitive science department".

Sa iba pang dako, 1943 minsan ang ibinigay na petsa bilang unang taon para sa teknolohiya. Sa alinmang paraan, sa loob ng humigit-kumulang 70 taon, iminumungkahi ng mga account na ang mga neural network ay lumipat at lumalabas sa uso, kadalasang napapabayaan ngunit kung minsan ay humahawak at lumipat sa mas pangunahing mga aplikasyon at debate. Nagpatuloy ang kawalan ng katiyakan. Ang mga naunang developer na iyon ay madalas na naglalarawan sa kahalagahan ng kanilang pananaliksik bilang hindi napapansin, hanggang sa matagpuan nito ang layunin nito madalas na mga taon at kung minsan ay makalipas ang mga dekada.

Sa paglipat mula sa 1960s hanggang sa huling bahagi ng 1970s, makakahanap tayo ng higit pang mga kuwento ng mga hindi kilalang katangian ng mga system na ito. Kahit na noon, pagkatapos ng tatlong dekada, ang neural network ay naghahanap pa rin ng kahulugan ng layunin. Si David Rumelhart, na may background sa psychology at naging co-author ng isang set ng mga libro na inilathala noong 1986 na kalaunan ay magtutulak muli ng atensyon patungo sa mga neural network, ay natagpuan ang kanyang sarili na nakikipagtulungan sa pagbuo ng mga neural network. kasama ang kanyang kasamahan na si Jay McClelland.

Pati na rin bilang mga kasamahan, kamakailan lamang ay nakatagpo nila ang isa't isa sa isang kumperensya sa Minnesota kung saan ang pahayag ni Rumelhart sa "pag-unawa sa kuwento" ay nagbunsod ng ilang talakayan sa mga delegado.

Kasunod ng kumperensyang iyon ay bumalik si McClelland na may pag-iisip tungkol sa kung paano bumuo ng isang neural network na maaaring pagsamahin ang mga modelo upang maging mas interactive. Ang mahalaga dito ay Ang paggunita ni Rumelhart ng "mga oras at oras at oras ng pag-iisip sa computer".

Umupo kami at ginawa ang lahat ng ito sa computer at ginawa ang mga modelong ito ng computer, at hindi namin naiintindihan ang mga ito. Hindi namin naintindihan kung bakit sila nagtrabaho o kung bakit hindi sila nagtrabaho o kung ano ang kritikal sa kanila.

Tulad ni Taylor, natagpuan ni Rumelhart ang kanyang sarili na nakikipag-usap sa sistema. Gumawa rin sila ng gumaganang neural network at, higit sa lahat, hindi rin sila sigurado kung paano o bakit ito gumana sa paraang ito, tila natututo mula sa data at paghahanap ng mga asosasyon.

Paggaya sa utak - patong-patong

Maaaring napansin mo na kapag tinatalakay ang mga pinagmulan ng mga neural network, ang imahe ng utak at ang pagiging kumplikado nito ay hindi malayo. Ang utak ng tao ay kumilos bilang isang uri ng template para sa mga sistemang ito. Sa mga unang yugto, sa partikular, ang utak - isa pa rin sa mga dakilang hindi alam - ay naging isang modelo para sa kung paano maaaring gumana ang neural network.

Kaya ang mga pang-eksperimentong bagong sistemang ito ay ginawan ng modelo sa isang bagay na ang paggana mismo ay hindi alam. Ang neurocomputing engineer na si Carver Mead ay nagsalita nang hayag ng konsepto ng isang "cognitive iceberg" na nakita niyang partikular na nakakaakit. Ito ay ang dulo lamang ng malaking bato ng yelo ng kamalayan na alam natin at nakikita. Ang sukat at anyo ng iba ay nananatiling hindi alam sa ibaba ng ibabaw.

Sa 1998, James Anderson, na matagal nang nagtatrabaho sa mga neural network, ay nagsabi na pagdating sa pagsasaliksik sa utak "ang aming pangunahing pagtuklas ay tila isang kamalayan na talagang hindi namin alam kung ano ang nangyayari".

Sa isang detalyadong account sa Financial Times sa 2018, binanggit ng mamamahayag ng teknolohiya na si Richard Waters kung paano ang mga neural network ay "itinulad sa isang teorya tungkol sa kung paano gumagana ang utak ng tao, na nagpapasa ng data sa mga layer ng mga artipisyal na neuron hanggang sa lumitaw ang isang makikilalang pattern". Lumilikha ito ng isang knock-on na problema, iminungkahi ng Waters, bilang "hindi tulad ng mga logic circuit na ginagamit sa isang tradisyunal na software program, walang paraan ng pagsubaybay sa prosesong ito upang matukoy nang eksakto kung bakit ang isang computer ay may partikular na sagot". Ang konklusyon ni Waters ay ang mga resultang ito ay hindi maaaring alisin. Ang paggamit ng ganitong uri ng modelo ng utak, na kumukuha ng data sa maraming mga layer, ay nangangahulugan na ang sagot ay hindi madaling masubaybayan. Ang maraming layering ay isang magandang bahagi ng dahilan para dito.

Hardesty napagmasdan din na ang mga sistemang ito ay "ginawa nang maluwag sa utak ng tao". Nagdudulot ito ng kasabikan na bumuo ng mas kumplikadong pagproseso upang subukang tumugma sa utak. Ang resulta ng layuning ito ay isang neural net na "binubuo ng libu-libo o kahit na milyon-milyong mga simpleng processing node na makapal na magkakaugnay". Ang data ay gumagalaw sa mga node na ito sa isang direksyon lamang. Naobserbahan ni Hardesty na ang isang "indibidwal na node ay maaaring konektado sa ilang mga node sa layer sa ilalim nito, kung saan ito tumatanggap ng data, at ilang mga node sa layer sa itaas nito, kung saan ito nagpapadala ng data".

Ang mga modelo ng utak ng tao ay bahagi ng kung paano nabuo at idinisenyo ang mga neural network na ito mula sa simula. Ito ay partikular na kawili-wili kapag isinasaalang-alang natin na ang utak ay mismong isang misteryo ng panahon (at sa maraming paraan ay hanggang ngayon).

'Ang adaptasyon ay ang buong laro'

Nais ng mga siyentipiko tulad ni Mead at Kohonen na lumikha ng isang sistema na maaaring tunay na umangkop sa mundo kung saan ito natagpuan mismo. Sasagot ito sa mga kondisyon nito. Malinaw ni Mead na ang halaga sa mga neural network ay maaari nilang mapadali ang ganitong uri ng pagbagay. Sa panahong iyon, at pagninilay-nilay sa ambisyong ito, Idinagdag ni Mead na ang paggawa ng adaptasyon ay "ang buong laro". Ang pagbagay na ito ay kailangan, naisip niya, "dahil sa likas na katangian ng totoong mundo", na kanyang napagpasyahan ay "masyadong variable upang gawin ang anumang bagay na ganap".

Ang problemang ito ay kailangang isaalang-alang lalo na bilang, naisip niya, ito ay isang bagay na "matagal nang nalaman ng nervous system". Hindi lamang ang mga innovator na ito ay gumagana sa isang imahe ng utak at mga hindi alam nito, pinagsasama nila ito sa isang pangitain ng "tunay na mundo" at ang mga kawalan ng katiyakan, hindi alam at pagkakaiba-iba na dulot nito. Ang mga sistema, naisip ni Mead, ay kailangang tumugon at umangkop sa mga pangyayari wala tagubilin.

Sa parehong oras noong 1990s, si Stephen Grossberg - isang dalubhasa sa mga sistemang nagbibigay-malay na nagtatrabaho sa matematika, sikolohiya at bioemedical engineering - nakipagtalo din iyon Ang pagbagay ay magiging mahalagang hakbang sa mas mahabang panahon. Si Grossberg, habang nagtatrabaho siya sa pagmomodelo ng neural network, naisip niya na ang lahat ay "tungkol sa kung paano idinisenyo ang mga biological measurement at control system upang mabilis at matatag na umangkop sa real time sa isang mabilis na pabago-bagong mundo." Tulad ng nakita natin kanina sa "pangarap" ni Kohonen ng isang "self-organizing" na sistema, isang paniwala ng "tunay na mundo" ang nagiging konteksto kung saan ang pagtugon at pagbagay ay inilalagay sa mga sistemang ito. Kung paano nauunawaan at naiisip ang tunay na mundong iyon ay walang alinlangan na humuhubog kung paano idinisenyo ang mga sistemang ito upang umangkop.

Mga nakatagong layer

Habang dumarami ang mga layer, ang malalim na pag-aaral ay nagpabagal sa mga bagong lalim. Ang neural network ay sinanay gamit ang data ng pagsasanay na, Paliwanag ni Hardesty, "ay ibinibigay sa ilalim na layer - ang input layer - at ito ay dumaan sa mga susunod na layer, na dumarami at nagsasama-sama sa mga kumplikadong paraan, hanggang sa tuluyang dumating, na radikal na nabago, sa output layer". Ang mas maraming mga layer, mas malaki ang pagbabago at mas malaki ang distansya mula sa input hanggang sa output. Ang pagbuo ng Graphics Processing Units (GPUs), sa paglalaro halimbawa, idinagdag ni Hardesty, "nagbigay-daan sa isang-layer na network noong 1960s at ang dalawa hanggang tatlong-layer na network noong 1980s na umunlad sa sampu, 15, o kahit 50 -layer network ng ngayon".

Lumalalim ang mga neural network. Sa katunayan, ito ang pagdaragdag ng mga layer, ayon kay Hardesty, iyon ang "kung ano ang tinutukoy ng 'deep' sa 'deep learning'". Mahalaga ito, iminungkahi niya, dahil "sa kasalukuyan, ang malalim na pag-aaral ay responsable para sa pinakamahusay na gumaganap na mga sistema sa halos bawat lugar ng pananaliksik sa artificial intelligence".

Ngunit ang misteryo ay lumalalim pa rin. Habang tumataas ang mga layer ng mga neural network ay lumaki ang kanilang pagiging kumplikado. Nagdulot din ito ng paglaki sa tinatawag na "mga nakatagong layer" sa loob ng mga kalaliman na ito. Ang talakayan tungkol sa pinakamainam na bilang ng mga nakatagong layer sa isang neural network ay patuloy. Ang media theorist Nagsulat si Beatrice Fazi na "dahil sa kung paano gumagana ang isang malalim na neural network, umaasa sa mga nakatagong neural layer na nasa pagitan ng unang layer ng mga neuron (ang input layer) at ang huling layer (ang output layer), ang mga diskarte sa deep-learning ay kadalasang opaque o hindi mabasa kahit na sa mga programmer na orihinal na nag-set up sa kanila".

Habang tumataas ang mga layer (kabilang ang mga nakatagong layer na iyon) mas nagiging hindi maipaliwanag ang mga ito - kahit na, tulad ng lumalabas, muli, sa mga gumagawa nito. Gumagawa ng katulad na punto, ang prominente at interdisciplinary na bagong media thinker na si Katherine Hayles nabanggit din na may mga limitasyon sa "gaano natin malalaman ang tungkol sa system, isang resulta na nauugnay sa 'nakatagong layer' sa neural net at mga algorithm ng malalim na pag-aaral."

Hinahabol ang hindi maipaliwanag

Kung pinagsama-sama, ang mga mahabang pag-unlad na ito ay bahagi ng kung ano ang sosyolohista ng teknolohiya Taina Bucher ay tinatawag na "problema ng hindi alam". Ang pagpapalawak ng kanyang maimpluwensyang pananaliksik sa siyentipikong kaalaman sa larangan ng AI, si Harry Collins ay itinuro na ang layunin ng mga neural net ay na ang mga ito ay maaaring gawin ng isang tao, sa simula man lang, ngunit “kapag naisulat na ang programa ay nabubuhay sa sarili nitong buhay, kumbaga; nang walang malaking pagsisikap, eksakto kung paano gumagana ang programa ay maaaring manatiling mahiwaga". Ito ay may mga alingawngaw ng mga matagal nang pangarap ng isang self-organizing system.

Idaragdag ko dito na ang hindi alam at marahil ang hindi alam ay hinabol bilang pangunahing bahagi ng mga sistemang ito mula sa kanilang mga pinakaunang yugto. Malaki ang posibilidad na kung mas malaki ang epekto ng artificial intelligence sa ating buhay ay hindi natin mauunawaan kung paano o bakit.

Ngunit hindi iyon angkop sa marami ngayon. Gusto naming malaman kung paano gumagana ang AI at kung paano ito nakakarating sa mga desisyon at resulta na nakakaapekto sa amin. Habang patuloy na hinuhubog ng mga pag-unlad sa AI ang ating kaalaman at pag-unawa sa mundo, kung ano ang ating natuklasan, kung paano tayo ginagamot, kung paano tayo natututo, kumakain at nakikipag-ugnayan, lalago ang udyok na ito upang maunawaan. Pagdating sa maipaliwanag at transparent na AI, sinasabi sa atin ng kuwento ng mga neural network na malamang na mas malayo tayo sa layuning iyon sa hinaharap, sa halip na mas malapit dito.

David Beer, Propesor ng Sosyolohiya, University of York

Ang artikulong ito ay muling nai-publish mula sa Ang pag-uusap sa ilalim ng lisensya ng Creative Commons. Basahin ang ang orihinal na artikulo.