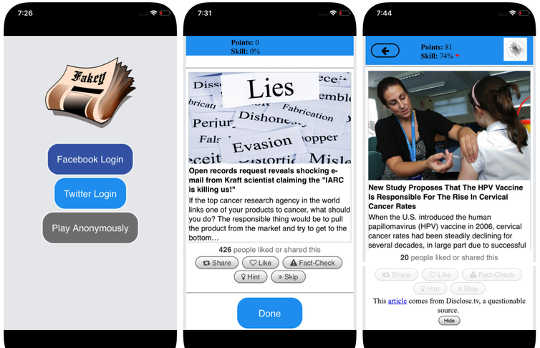

Mga screenshot ng laro ng Fakey. Mihai Avram at Filippo Menczer

Mga screenshot ng laro ng Fakey. Mihai Avram at Filippo Menczer

Ang mga social media ay kabilang sa pangunahing pinagkukunan ng balita sa US at sa buong mundo. Gayunpaman ang mga gumagamit ay nakalantad sa nilalaman ng kaduda-dudang katumpakan, kabilang teorya ng pagsasabwatan, clickbait, hyperpartisan na nilalaman, pseudo science at kahit gawa ng "pekeng balita" na mga ulat.

Hindi nakakagulat na may napakaraming disinformation na nai-publish: Spam at online na pandaraya ay kapaki-pakinabang para sa mga kriminal, at pampropaganda at propaganda sa pulitika kapwa partidista at pinansiyal na benepisyo. Ngunit ang katotohanan na Ang mabilis na pag-download ng nilalaman ng mababang-kredibilidad ay mabilis at madali ay nagpapahiwatig na ang mga tao at ang mga algorithm sa likod ng mga social media platform ay mahina sa pagmamanipula.

Nakilala ng aming pananaliksik ang tatlong uri ng bias na nagpapahirap sa ecosystem ng social media sa parehong intensyonal at di-sinasadyang maling impormasyon. Iyon ang dahilan kung bakit ang aming Obserbatoryo sa Social Media Ang Indiana University ay nagtatayo mga kasangkapan upang tulungan ang mga tao na magkaroon ng kamalayan sa mga biases na ito at protektahan ang kanilang sarili mula sa mga impluwensya sa labas na dinisenyo upang pagsamantalahan ang mga ito.

Nagpapaliwanag ng mga tool na binuo sa Observatory sa Social Media:

{youtube}https://youtu.be/BIv9054dBBI{/youtube}

Bias sa utak

Ang mga cognitive biases ay nagmumula sa paraan ng pagproseso ng utak ng impormasyon na nakatagpo ng bawat tao sa bawat araw. Ang utak ay maaaring makitungo lamang ng isang may hangganan na halaga ng impormasyon, at masyadong maraming papasok na stimuli ang maaaring maging sanhi impormasyon Sobra. Na mismo ay may malubhang implikasyon para sa kalidad ng impormasyon sa social media. Nalaman namin na ang matarik na kumpetisyon para sa limitadong pansin ng mga gumagamit ay nangangahulugang iyon ang ilang mga ideya ay nagiging viral sa kabila ng kanilang mababang kalidad - kahit na gusto ng mga tao na magbahagi ng mataas na kalidad na nilalaman.

Upang maiwasan ang paglaho, ang utak ay gumagamit ng isang bilang ng mga trick. Ang mga pamamaraan na ito ay karaniwang epektibo, ngunit maaari din maging biases kapag inilapat sa maling konteksto.

Ang isang cognitive shortcut ay nangyayari kapag ang isang tao ay nagpapasiya kung magbahagi ng isang kuwento na lumilitaw sa kanilang feed sa social media. Ang mga tao ay tunay na apektado ng emosyonal na kahulugan ng isang headline, kahit na iyon ay hindi isang magandang tagapagpahiwatig ng katumpakan ng isang artikulo. Mas mahalaga pa na sumulat ng piraso.

Para mapaglabanan ang bias na ito, at tulungan ang mga tao na magbayad nang higit na pansin sa pinagmumulan ng isang paghahabol bago ito ibabahagi, binuo namin Fakey, isang mobile balita literacy game (libre sa Android at iOS) na tumutulad sa isang tipikal na feed ng balita sa social media, na may isang halo ng mga artikulo ng balita mula sa mga pinagmumulan ng mapagkukunan ng mainstream at mababa ang kredibilidad. Ang mga manlalaro ay nakakakuha ng higit pang mga puntos para sa pagbabahagi ng mga balita mula sa maaasahang mga mapagkukunan at pag-flag ng kahina-hinalang nilalaman para sa fact-check. Sa proseso, natututo silang kilalanin ang mga senyales ng kredibilidad ng pinagmulan, tulad ng mga claim sa hyperpartisan at mga pinalabas na emosyonal na mga headline.

Bias sa lipunan

Ang isa pang mapagkukunan ng bias ay nagmumula sa lipunan. Kapag ang mga tao ay kumonekta nang direkta sa kanilang mga kapantay, ang mga biasing sa panlipunan na gumagabay sa kanilang pagpili ng mga kaibigan ay may impluwensya sa impormasyong nakikita nila.

Sa katunayan, sa aming pananaliksik nalaman namin na posible na matukoy ang mga pampulitikang leanings ng isang gumagamit ng Twitter sa pamamagitan lamang ng pagtingin sa mga kagustuhan ng partidista ng kanilang mga kaibigan. Ang aming pagsusuri sa istruktura ng mga ito mga network ng partidong komunikasyon natagpuan ang mga social network ay partikular na mahusay sa pagpapakalat ng impormasyon - tumpak o hindi - kung kailan ang mga ito ay mahigpit na nakagapos at nakakalas sa ibang mga bahagi ng lipunan.

Ang pagkahilig upang masuri ang impormasyon na mas may pasubali kung ito ay nagmumula sa loob ng kanilang sariling mga social circle ay lumilikha ng "echo kamara"Na hinog na para sa pagmamanipula, alinman sa sinasadya o hindi sinasadya. Tinutulungan nito ang ipaliwanag kung bakit napakarami ang online na pag-uusap "Laban sa amin" mga confrontations.

Upang pag-aralan kung paano ang istruktura ng mga online social network ay gumagawa ng mga gumagamit na mahina laban sa disinformation, binuo namin Hoaxy, isang sistema na sumusubaybay at nakikita ang pagkalat ng nilalaman mula sa mga pinagmumulan ng mababang-kredibilidad, at kung paano ito nakikipagkumpitensya sa nilalaman ng pag-check sa katotohanan. Ang aming pag-aaral ng data na nakolekta sa pamamagitan ng Hoaxy sa panahon ng halalan pampanguluhan 2016 US ay nagpapakita na ang Twitter account na ibinahagi maling impormasyon ay halos ganap na putulin mula sa mga pagwawasto na ginawa ng fact-checkers.

Nang pagbabarad namin ang mga misinformation-spreading na mga account, natagpuan namin ang isang napaka-siksik na pangunahing grupo ng mga account na nag-retweet ng bawat isa halos eksklusibo - kabilang ang ilang mga bot. Ang mga tanging beses na mga fact-checking na organisasyon ay kailanman naka-quote o nabanggit sa pamamagitan ng mga gumagamit sa maling impormasyon group ay kapag pagtatanong sa kanilang pagkakasunud-sunod o pagtubos sa kabaligtaran ng kung ano ang kanilang isinulat.

Ang mga bias sa makina

Ang ikatlong grupo ng mga biases ay direktang nagmumula sa mga algorithm na ginagamit upang matukoy kung anong mga tao ang nakikita online. Ang parehong mga social media platform at mga search engine ay gumagamit ng mga ito. Ang mga teknolohiya sa pag-personalize ay idinisenyo upang piliin lamang ang pinaka-makatawag pansin at may-katuturang nilalaman para sa bawat indibidwal na gumagamit. Ngunit sa paggawa nito, ito ay maaaring magtagumpay sa mga nagbibigay-malay at sosyal na biases ng mga gumagamit, sa gayon ginagawa itong mas mahina sa pagmamanipula.

Halimbawa, ang detalyadong mga tool sa advertising na binuo sa maraming mga social media platform hayaan ang mga disinformation campaigners maningning na tagumpay confirmation bias by pag-uugali ng mga mensahe sa mga taong nahilig na maniwala sa kanila.

Gayundin, kung ang isang gumagamit ay madalas na nag-click sa mga link sa Facebook mula sa isang partikular na mapagkukunan ng balita, ang Facebook ay malamang na ipakita ang taong iyon nang higit pa sa nilalaman ng site na iyon. Ang tinatawag na "filter bubble"Ang epekto ay maaaring ihiwalay ang mga tao mula sa magkakaibang pananaw, pagpapalakas ng mga bias sa pagkumpirma.

Ipinapakita ng aming sariling pananaliksik na inilalantad ng mga social media platform ang mga gumagamit sa isang mas magkakaibang hanay ng mga mapagkukunan kaysa sa mga non-social media site tulad ng Wikipedia. Dahil ito ay nasa antas ng isang buong plataporma, hindi ng isang nag-iisang gumagamit, tinatawagan namin ito ang mga homogeneity bias.

Ang isa pang mahalagang sangkap ng social media ay ang impormasyon na nagte-trend sa platform, ayon sa kung ano ang nakakakuha ng pinakamaraming mga pag-click. Tinatawag namin ito popular na bias, dahil nalaman namin na ang isang algorithm na dinisenyo upang itaguyod ang sikat na nilalaman ay maaaring negatibong nakakaapekto sa pangkalahatang kalidad ng impormasyon sa platform. Naging feed din ito sa mga umiiral na nagbibigay-malay na bias, na nagpapalakas sa kung ano ang mukhang popular na hindi isinasaalang-alang ang kalidad nito.

Ang lahat ng mga algorithmic biases ay maaaring manipulahin ng mga social bot, mga programa sa computer na nakikipag-ugnayan sa mga tao sa pamamagitan ng mga social media account. Karamihan sa mga social bot, tulad ng Twitter Big Ben, ay hindi nakakapinsala. Gayunman, itinatakip ng ilan ang kanilang tunay na kalikasan at ginagamit para sa malisyosong mga hangarin, tulad ng pagpapalakas ng disinformation o kasinungalingan ang paglikha ng hitsura ng isang kilusan sa katutubo, na tinatawag ding "astroturfing." Natagpuan namin katibayan ng ganitong uri ng pagmamanipula sa run-up sa 2010 US midterm election.

Upang pag-aralan ang mga diskarte sa pagmamanipula, bumuo kami ng tool upang makita ang mga social bots na tinatawag Botometer. Ang botometer ay gumagamit ng pag-aaral ng machine upang makita ang mga account ng bot, sa pamamagitan ng pag-inspeksyon sa libu-libong iba't ibang mga tampok ng Twitter account, tulad ng mga oras ng mga post nito, kung gaano kadalas ito tweet, at ang mga account na ito ay sumusunod at nag-retweet. Ito ay hindi perpekto, ngunit ito ay nagsiwalat na kasing dami ng Ang 15 na porsiyento ng mga account ng Twitter ay nagpapakita ng mga palatandaan ng pagiging bot.

Paggamit ng Botometer kasabay ng Hoaxy, sinuri namin ang core ng misinformation network sa panahon ng 2016 US presidential campaign. Nakakita kami ng maraming mga bots na pinagsamantalahan ang parehong mga nagbibigay-malay, pagkumpirma at pagkilala sa pagiging popular ng kanilang mga biktima at mga algorithmic biases ng Twitter.

Ang mga bot na ito ay makagawa ng mga bula ng filter sa mga mahihinang gumagamit, na nagpapakain sa mga maling pag-aangkin at maling impormasyon. Una, maaari nilang maakit ang pansin ng mga gumagamit ng tao na sumusuporta sa isang partikular na kandidato sa pamamagitan ng pag-tweet sa mga mayhtags ng kandidato o sa pagbanggit at pag-retweet sa taong iyon. Pagkatapos, ang mga bot ay maaaring magpalawak ng mga huwad na pag-uusig ng mga kalaban sa pamamagitan ng pag-retweet ng mga artikulo mula sa mga pinagmumulan ng kredibilidad na tumutugma sa ilang mga keyword. Ginagawa din ng aktibidad na ito ang highlight ng algorithm para sa iba pang mga gumagamit ng mga maling kuwento na ibinabahagi nang malawakan.

Pag-unawa sa mga kumplikadong kahinaan

Kahit na ang aming pananaliksik, at iba pa, ay nagpapakita kung paano maaaring manipulahin ang mga indibidwal, institusyon at kahit na buong lipunan sa social media, mayroong maraming tanong naiwan upang sagutin. Napakahalaga na matuklasan kung paano nakikipag-ugnayan ang iba't ibang mga biases sa bawat isa, na maaaring lumikha ng mas kumplikadong mga kahinaan.

Ang mga kasangkapan tulad ng aming nag-aalok ng mga gumagamit ng internet ng karagdagang impormasyon tungkol sa disinformation, at sa gayon ang ilang antas ng proteksyon mula sa mga pinsala nito. Ang mga solusyon ay malamang na hindi lamang teknolohikal, bagaman maaaring may ilang mga teknikal na aspeto sa kanila. Ngunit dapat nilang isaalang-alang ang mga nagbibigay-malay at sosyal na aspeto ng problema.

Tungkol sa Ang May-akda

Giovanni Luca Ciampaglia, Assistant Research Scientist, Indiana University Network Science Institute, Indiana University at Filippo Menczer, Propesor ng Computer Science at Informatics; Direktor ng Center para sa Complex Networks and Systems Research, Indiana University

Ang artikulong ito ay orihinal na na-publish sa Ang pag-uusap. Basahin ang ang orihinal na artikulo.

Mga Kaugnay Books

at

Salamat sa pagbisita InnerSelf.com, Kung saan mayroon 20,000 + mga artikulong nagbabago sa buhay na nagtataguyod ng "Mga Bagong Saloobin at Bagong Posibilidad." Ang lahat ng mga artikulo ay isinalin sa 30+ wika. sumuskribi sa InnerSelf Magazine, na inilathala linggu-linggo, at Araw-araw na Inspirasyon ni Marie T Russell. InnerSelf Magazine ay nai-publish mula noong 1985.

Salamat sa pagbisita InnerSelf.com, Kung saan mayroon 20,000 + mga artikulong nagbabago sa buhay na nagtataguyod ng "Mga Bagong Saloobin at Bagong Posibilidad." Ang lahat ng mga artikulo ay isinalin sa 30+ wika. sumuskribi sa InnerSelf Magazine, na inilathala linggu-linggo, at Araw-araw na Inspirasyon ni Marie T Russell. InnerSelf Magazine ay nai-publish mula noong 1985.